Disponible con licencia de Image Analyst.

El asistente Entrenar un modelo de aprendizaje profundo es un flujo de trabajo asistido para ayudarle a entrenar un modelo de aprendizaje profundo utilizando los datos de entrenamiento que ha recopilado. Una vez que tenga los datos de entrenamiento, abra el asistente Entrenar un modelo de aprendizaje  profundo en la pestaña Imágenes, en el menú desplegable Herramientas de aprendizaje profundo

profundo en la pestaña Imágenes, en el menú desplegable Herramientas de aprendizaje profundo  .

.

Hay tres páginas para este asistente: Empezar, Entrenar y Resultado.

Para utilizar el asistente Entrenar un modelo de aprendizaje profundo, complete los siguientes pasos:

- Haga clic en la pestaña Imágenes.

- Haga clic en el menú desplegable Herramientas de aprendizaje profundo

y seleccione Entrenar un modelo de aprendizaje profundo

y seleccione Entrenar un modelo de aprendizaje profundo  .

.Aparecerá el panel del asistente Entrenar un modelo de aprendizaje profundo.

Primeros pasos

En la página Comenzar del asistente, debe especificar cómo entrenar el modelo de aprendizaje profundo.

- Especifique cómo desea entrenar el modelo.

- Definir los parámetros automáticamente: el tipo de modelo, los parámetros y los hiperparámetros se definen automáticamente para construir el mejor modelo.

- Especificar mis propios parámetros: usted define el tipo de modelo, los parámetros y los hiperparámetros para construir el modelo.

- Haga clic en el botón Siguiente para pasar a la página Entrenar.

Tren

En la página Entrenar, se define la información de los parámetros para el entrenamiento. En función de la opción que haya definido en la página Comenzar, los parámetros pueden variar.

- Especifique los parámetros requeridos.

Datos de entrenamiento de entrada

Carpetas que contienen los chips de imagen, las etiquetas y las estadísticas necesarias para entrenar el modelo. Esta es la salida de la herramienta Exportar datos de entrenamiento para aprendizaje profundo.

Modelo de salida

(Entrenamiento automático)

Modelo entrenado de salida que se guardará como un paquete de aprendizaje profundo (archivo .dlpk).

Carpeta de salida

(Entrenamiento manual)

La ubicación de la carpeta de salida donde se almacenará el modelo entrenado.

- Si lo desea, defina otros parámetros.

Parámetros de entrenamiento automático

Parámetro Descripción Modelo preentrenado

Un modelo previamente entrenado que se usará para ajustar el nuevo modelo. La entrada es un archivo de definición de modelo Esri (.emd) o un archivo de paquete de aprendizaje profundo (.dlpk).

Puede ajustarse un modelo previamente entrenado con clases similares para adaptarse al nuevo modelo. El modelo previamente entrenado debe haber sido entrenado con el mismo tipo de modelo y modelo base que se usará para entrenar el nuevo modelo.

Límite de tiempo total (en horas)

Límite de tiempo total en horas que tomará el entrenamiento del modelo AutoDL. El valor predeterminado es de 2 horas.

Modo de aprendizaje profundo automático

Especifica el modo AutoDL que se utilizará y la intensidad de la búsqueda AutoDL.

- Básico: entrena todas las redes seleccionadas sin ajuste de hiperparámetros.

- Avanzado: realice el ajuste de hiperparámetros en los dos modelos con mejores resultados.

Redes neuronales

Especifica las arquitecturas que se utilizarán para entrenar el modelo.

De forma predeterminada, se utilizarán todas las redes.

Guardar modelos evaluados

Especifica si se guardarán todos los modelos evaluados.

- Activado: se guardarán todos los modelos evaluados.

- Desactivado: solo se guardará el modelo de mayor rendimiento. Esta es la opción predeterminada.

Parámetros de entrenamiento manual

Parámetro Descripción Máximo de épocas

Número máximo de épocas para las que se entrenará el modelo. Una época máxima de uno significa que el dataset se enviará hacia delante y hacia atrás a través de la red neuronal una vez. El valor predeterminado es 20.

Modelo preentrenado

Modelo previamente entrenado que se utilizará para ajustar con precisión el nuevo modelo. La entrada es un archivo de definición de modelo Esri (.emd) o un archivo de paquete de aprendizaje profundo (.dlpk).

Se puede ajustar un modelo previamente entrenado con clases similares para que se adecue al nuevo modelo. El modelo previamente entrenado se debe haber entrenado con el mismo tipo de modelo y el mismo modelo de base que se utilizará para entrenar el nuevo modelo.

Tipo de modelo

Especifica el tipo de modelo que se usará para entrenar el modelo de aprendizaje profundo.

Para obtener más información sobre los distintos tipos de modelos, consulte Arquitecturas de modelos de aprendizaje profundo

Argumentos de modelo

La información del parámetro Tipo de modelo se utilizará para rellenar este parámetro. Estos argumentos varían dependiendo de la arquitectura del modelo. A continuación se describen los argumentos de modelo admitidos para los modelos entrenados en ArcGIS. Los modelos preentrenados de ArcGIS y los modelos de aprendizaje profundo personalizados pueden tener argumentos adicionales que son compatibles con las herramientas.

Para obtener más información sobre los argumentos que están disponibles para cada tipo de modelo, consulte Argumentos de aprendizaje profundo.

Aumento de datos

Especifica el tipo de aumento de datos que se utilizará.

El aumento de datos es una técnica para aumentar artificialmente el conjunto de entrenamiento mediante la creación de copias modificadas de un dataset utilizando los datos existentes.

- Predeterminado: se utilizarán los parámetros y valores predeterminados de aumento de datos. Los métodos de aumento de datos predeterminados incluidos son crop, dihedral_affine, brightness, contrast y zoom. Estos valores predeterminados suelen funcionar bien para las imágenes de satélite.

- Ninguno: no se aumentarán los datos.

- Personalizado: especifica valores de aumento de datos definidos por el usuario en el parámetro Parámetros de aumento.

- Archivo: especifica las transformaciones fastai para el aumento de datos de los datasets de entrenamiento y validación. Se especifican en un archivo .json llamado transforms.json que se encuentra en la misma carpeta que los datos de entrenamiento. Para más información sobre las diferentes transformaciones, vea transformaciones de visión fastai.

Parámetros de aumento

Especifica el valor de cada transformación en el parámetro de aumento.

- rotate: la imagen se girará aleatoriamente (en grados) con una probabilidad (p). Si grados es un rango (a,b), se asignará uniformemente un valor de a a b. El valor predeterminado es 30.0; 0.5.

- brightness: el brillo de la imagen se ajustará aleatoriamente en función del valor de cambio, con una probabilidad (p). Un cambio de 0 transformará la imagen en la más oscura, y un cambio de 1 transformará la imagen en la más clara. Un cambio de 0,5 no ajustará el brillo. Si el cambio es un rango (a,b), el aumento asignará uniformemente un valor de a a b. El valor predeterminado es (0,4,0,6); 1,0.

- contrast: el contraste de la imagen se ajustará aleatoriamente en función del valor de escala con probabilidad (p). Una escala de 0 transformará la imagen a escala de grises, y una escala mayor que 1 transformará la imagen a supercontraste. Una escala de 1 no ajusta el contraste. Si la escala es un rango (a,b), el aumento asignará uniformemente un valor de a a b. El valor predeterminado es (0,75, 1,5); 1,0.

- zoom: la imagen se ampliará aleatoriamente en función del valor de la escala. El valor del zoom tiene la forma scale(a,b); p. El valor predeterminado es (1.0, 1.2); 1.0 en el cual p es la probabilidad. Solamente una escala superior a 1,0 ampliará la imagen. Si escala es un rango (a,b), asignará uniformemente un valor de a a b.

- crop: la imagen se recortará aleatoriamente. El valor del recorte está en la forma size;p;row_pct;col_pct en la cual p es la probabilidad. La posición viene dada por (col_pct, row_pct),, con col_pct y row_pct being normalizados entre 0 y 1. Si col_pct o row_pct es un rango (a,b), asignará uniformemente un valor de a a b. El valor predeterminado es chip_size;1.0; (0, 1); (0, 1) en el que 224 es el tamaño de chip por defecto predeterminado.

Tamaño de lote

Número de muestras de entrenamiento que se procesarán para el entrenamiento a la vez.

Aumentar el tamaño de lote puede mejorar el rendimiento de la herramienta; sin embargo, a medida que aumenta el tamaño del lote, se utiliza más memoria.

Cuando no se dispone de suficiente memoria en la GPU para el tamaño de lote establecido, la herramienta intenta estimar y utilizar un tamaño de lote óptimo. Si se produce un error de memoria insuficiente, utilice un tamaño de lote más pequeño.

% de validación

Porcentaje de muestras de entrenamiento que se utilizarán para validar el modelo. El valor predeterminado es 10.

Tamaño de chip

El tamaño de la imagen para entrenar el modelo. Las imágenes se recortarán al tamaño de chip especificado. Si el tamaño de la imagen es inferior al valor del parámetro, se utilizará el tamaño de la imagen. El valor predeterminado es 224 píxeles.

Cambiar tamaño a

Cambia el tamaño de los chips de imagen. Una vez redimensionado el chip, se recortarán los bloques de píxeles del tamaño del chip y se utilizarán para el entrenamiento. Este parámetro solo se aplica a los datos de detección de objetos (PASCAL VOC), clasificación de objetos (teselas etiquetadas) y superresolución.

El valor de redimensionamiento suele ser la mitad del valor del tamaño del chip. Si este valor de cambio de tamaño es menor que el valor del tamaño del chip, el valor de cambio de tamaño se utiliza para crear los bloques de píxeles para el entrenamiento.

Tasa de aprendizaje

Velocidad con la que se sobrescribirá la información existente con información recién adquirida a lo largo del proceso de formación. Si no se especifica ningún valor, el índice de aprendizaje óptimo se extraerá de la curva de aprendizaje durante el proceso de entrenamiento.

Modelo central

Especifica la red neuronal preconfigurada que se usará como arquitectura para entrenar el nuevo modelo. Este método se conoce como Aprendizaje de transferencia.

Además, se pueden especificar las redes neuronales convoluciales compatibles de modelos de imagen PyTorch (timm) utilizando timm como prefijo, por ejemplo, timm:resnet31 , timm:inception_v4 , timm:efficientnet_b3, etc.

Supervisar métrica

Especifica la métrica que se va a supervisar durante el control y la detención anticipada.

Detener cuando el modelo deja de mejorar

Especifica si se implementará la parada anticipada.

- Activado: se implementará la parada anticipada y el entrenamiento del modelo se detendrá cuando el modelo deje de mejorar, independientemente del valor del parámetro Épocas máx. especificado. Esta es la opción predeterminada.

- Desactivado: la parada anticipada del modelo no se implementará y el entrenamiento del modelo continuará hasta alcanzar el valor del parámetro Épocas máx.

Detener modelo

Especifica si las capas de base del modelo previamente entrenado se inmovilizarán, de modo que los pesos y sesgos permanezcan tal como se diseñaron originalmente.

- Activado: las capas de base se inmovilizarán y los pesos y sesgos predefinidos no se alterarán en el parámetro Modelo de base. Esta es la opción predeterminada.

- Desactivado: las capas de base no se inmovilizarán y los pesos y sesos del parámetro Modelo de base se pueden modificar para ajustarse a las muestras de entrenamiento. Esto tarda más tiempo en procesarse, pero generalmente produce mejores resultados.

Esquema de inicialización de pesos

Especifica el esquema en el que se inicializarán los pesos para la capa.

Para entrenar un modelo con datos multiespectrales, el modelo debe adaptarse a los distintos tipos de bandas disponibles. Esto se hace reinicializando la primera capa del modelo.

- Los pesos aleatorios se inicializarán para las bandas no RGB, y los pesos preentrenados se conservarán para las bandas RGB. Esta es la opción predeterminada.

- Banda roja: los pesos correspondientes a la banda roja de la capa del modelo preentrenado se clonarán para las bandas no RGB, y los pesos preentrenados se conservarán para las bandas RGB.

- Todos aleatorios: los pesos aleatorios se inicializarán tanto para bandas RGB como para bandas no RGB. Esta opción se aplica solamente a las imágenes multiespectrales.

Este parámetro solamente es aplicable cuando se utilizan imágenes multiespectrales en el modelo.

- Haga clic en el botón Siguiente para pasar a la página Resultado.

Resultado

La página Resultados muestra los detalles clave del modelo entrenado para que pueda revisarlos. También permite comparar el modelo entrenado con otros modelos. Comprender los modelos de aprendizaje profundo es esencial antes de utilizarlos para realizar inferencias. Revisar un modelo le ofrece una indicación de cómo se entrenó y cómo podría funcionar. En muchos casos, puede tener varios modelos para comparar.

| Elemento | Descripción |

|---|---|

Modelo | Utilice el botón Examinar |

Tipo de modelo | El nombre de la arquitectura modelo. |

Backbone | El nombre de la red neuronal preconfigurada que se utilizó como arquitectura para el modelo de entrenamiento. |

Tasa de aprendizaje | La tasa de aprendizaje utilizada en el entrenamiento de las redes neuronales. Si no especifica el valor, será calculado por la herramienta de formación. |

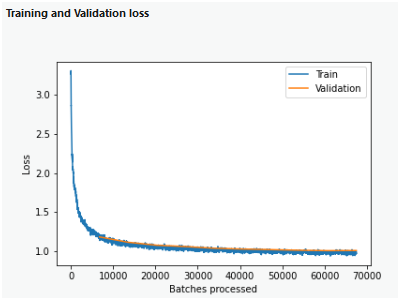

Pérdidas de entrenamiento y validación | Esta sección muestra un gráfico que muestra las pérdidas de entrenamiento y las pérdidas de validación a lo largo del entrenamiento del modelo.

|

Análisis del modelo | Una métrica o un número, en función de la arquitectura del modelo. Por ejemplo, los modelos de clasificación de píxeles mostrarán las siguientes métricas para cada clase: precisión, recuperación y f1-score. Los modelos de detección de objetos mostrarán la puntuación media de precisión. |

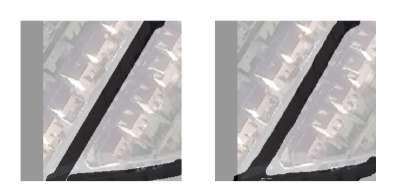

Resultados de muestra | Muestra ejemplos de pares de referencia del suelo y predicciones.

|

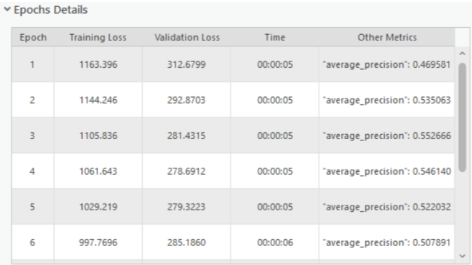

Detalles de épocas | Una tabla que contiene información para cada época, como la pérdida de entrenamiento, la pérdida de validación, el tiempo y otras métricas.

|

para buscar el modelo que desea revisar. Todos los modelos asociados a él se agregarán a la lista desplegable

para buscar el modelo que desea revisar. Todos los modelos asociados a él se agregarán a la lista desplegable