Ein wichtiger Bestandteil vieler GIS-Analyse-Workflows ist der Vergleich von zwei Variablen in einem Untersuchungsgebiet, um zu ermitteln, ob sie in Beziehung stehen, und falls ja, wie sie in Beziehung stehen. Gibt es beispielsweise eine Beziehung zwischen Adipositas- und Diabetesraten in bestimmten Regionen? In der Vergangenheit wurde eine solche Frage entweder durch einen sorgfältigen kartografischen Vergleich oder lineare Regressionsanalysen beantwortet. Aber: Der kartografische Vergleich kann subjektiv sein, und bei der Regressionsanalyse können nur einfache Zusammenhänge erkannt werden.

Mit dem Werkzeug Lokale bivariate Beziehungen können Sie die Beziehung zwischen zwei Variablen auf einer Karte quantifizieren, indem Sie bestimmen, ob die Werte einer Variable von den Werten einer anderen Variable abhängig sind oder von diesen beeinflusst werden, und ob diese Beziehungen im geografischen Raum variieren. Mit dem Werkzeug wird eine Entropiestatistik in jedem Viertel berechnet. Damit lässt sich die Menge an Informationen quantifizieren, die die beiden Variablen gemeinsam haben. Im Gegensatz zu anderen Statistiken, die oft nur lineare Beziehungen erfassen können (wie z. B. die lineare Regression), kann die Entropie alle strukturellen Beziehungen zwischen den beiden Variablen erfassen, einschließlich exponentieller, quadratischer, sinusförmiger und sogar komplexer Beziehungen, die sich nicht mit typischen mathematischen Funktionen darstellen lassen. Dieses Werkzeug kann Polygone oder Punkte verarbeiten und erstellt eine Ausgabe-Feature-Class, in der die Signifikanz und Form der Beziehungen der einzelnen Eingabe-Features zusammengefasst sind. Darüber hinaus bietet es benutzerdefinierte Pop-ups sowie eine Vielzahl von Diagnosen, Diagrammen und Meldungen.

Potenzielle Anwendungsbereiche

Das Werkzeug kann für die folgenden Arten von Anwendungen verwendet werden:

- Das US-amerikanische Center for Disease Control and Prevention (CDC) meint: "Menschen mit Adipositas haben im Vergleich zu Menschen mit normalem oder gesundem Gewicht ein erhöhtes Risiko für schwere Krankheiten und Gesundheitsprobleme, darunter Typ-2-Diabetes." Das CDC könnte dieses Werkzeug nutzen, um die angenommene Beziehung zwischen Adipositas und Diabetes zu quantifizieren und festzustellen, ob die Beziehung im gesamten Untersuchungsgebiet konsistent ist.

- Ein Mitarbeiter des Gesundheitswesens könnte die Beziehungen zwischen Luftverschmutzung und sozioökonomischen Faktoren untersuchen, um potenzielle umweltbedingte Ungerechtigkeiten zu erkennen.

Entropiemethode

Was bedeutet es, wenn zwei Variablen miteinander in Beziehung stehen? Es gibt viele Arten von Beziehungen zwischen Variablen, aber im einfachsten Sinne stehen zwei Variablen miteinander in Beziehung, wenn Informationen über die eine Variable durch Beobachtung von Werten der anderen Variable abgeleitet werden können. So können beispielsweise Informationen über das Diabetes-Risiko gewonnen werden, indem man Adipositas-Daten beobachtet. Dies wird als Abhängigkeit zwischen zwei Variablen bezeichnet, und wenn umgekehrt keine Informationen über eine Variable durch Beobachtung der anderen Variable gewonnen werden können, werden die Variablen als unabhängig bezeichnet.

Eine Möglichkeit, den Grad der Beziehung zwischen Variablen zu messen, ist die Entropie. Entropie ist ein grundlegendes Konzept der Informationstheorie und wird verwendet, um den Grad der Unsicherheit in einer Zufallsvariable zu quantifizieren. Im Allgemeinen gilt: Je weniger vorhersehbar die Variable, desto höher die Entropie. Entropie ist breit anwendbar und kann für einzelne Zufallsvariablen berechnet werden. Zwischen zwei oder mehreren Variablen kann die sogenannte Blockentropie berechnet werden. Die Blockentropie zweier Variablen ist gleich der Entropie der ersten Variable plus der Entropie der zweiten Variable, abzüglich der Transinformation der beiden Variablen. Die Transinformation dient als nützliche Quantifizierung des Grades der Abhängigkeit zwischen den Variablen, da sie direkt misst, wie viel Informationen über eine Variable sich durch die Beobachtung der Werte der anderen Variable gewinnen lassen.

Um die Transinformation zu schätzen, müssen die Entropie jeder einzelnen Variable und ihre Blockentropie geschätzt werden. Diese Werte hängen jedoch von den zugrunde liegenden Verteilungen der Variablen ab und sind in der Praxis fast nie bekannt. Neuere Forschungen haben jedoch erfreulicherweise gezeigt, dass die Blockentropie der Variablen geschätzt werden kann, indem nach Potenz gewichtete minimale Spannbäume als Proxy für die gemeinsame Verteilung der Variablen verwendet werden (Guo, 2010). Dies ermöglicht die Schätzung der Blockentropie, auch wenn die einzelnen Verteilungen der beiden Variablen nicht bekannt sind. Die Möglichkeit, die Blockentropie schätzen zu können, ist nützlich, aber die Transinformation zwischen den Variablen müssen Sie auch kennen, um festzustellen, ob die beiden Variablen miteinander in Beziehung stehen. Während sich die Transinformation nicht direkt schätzen lässt, ohne die Verteilungen der beiden Variablen zu kennen, ist es möglich, mit Hilfe von Permutationen einen Nullhypothesentest für statistisch signifikante Beziehungen zu erstellen.

Testen auf signifikante Beziehungen mithilfe von Permutationen

Wie im vorherigen Abschnitt gezeigt, ist die Frage, ob zwei Variablen miteinander in Beziehung stehen, gleichbedeutend mit der Frage, ob ihre Blockentropie (die geschätzt werden kann) signifikant kleiner ist als die Summe ihrer einzelnen Entropien (die nicht geschätzt werden kann). Anders ausgedrückt: Ist die geschätzte Blockentropie der Daten signifikant geringer, als sie es wäre, wenn die beiden Variablen unabhängig voneinander wären?

Um dies zu ermitteln, werden Permutationen mit den Variablen durchgeführt, indem jeder Wert der ersten Variable zufällig einem neuen Wert der zweiten Variable zugewiesen wird. Durch die Randomisierung der Paarungen verfügen die permutierten Datensätze über keine Transinformation, aber die einzelnen Entropien der beiden Variablen ändern sich nicht. Durch das Erzeugen vieler permutierter Datensätze und das Schätzen der Blockentropie der einzelnen Datensätze lässt sich eine Verteilung der Blockentropie unter der Nullhypothese erzeugen, dass die beiden Variablen unabhängig und nicht miteinander verbunden sind. Die anhand der tatsächlichen Daten geschätzte Blockentropie kann dann mit dieser Verteilung verglichen werden, und ein Pseudo-p-Wert kann berechnet werden, und zwar aus dem Anteil der Permutationen, deren Blockentropie kleiner ist als die Blockentropie der tatsächlichen Daten.

Testen auf lokale räumliche Beziehungen

Das vorstehend beschriebene Verfahren zum Testen auf signifikante Beziehungen zwischen zwei Variablen kann auf alle stetigen bivariaten Daten angewendet werden. Um dies in einen Test auf lokale räumliche Beziehungen zu umzuwandeln, wird der Hypothesentest für jedes Eingabe-Feature unter Verwendung der Nachbarn durchgeführt. Auf diese Weise können die Ergebnisse dargestellt werden und lokale Bereiche identifiziert werden, in denen die Variablen eine signifikante Beziehung aufweisen.

Alle Werte der Parameter Abhängige Variable und Erklärende Variable werden zunächst auf einen Wert zwischen 0 und 1 erneut skaliert. Dazu wird der Minimalwert für das gesamte Dataset subtrahiert und durch den Bereich (Maximum minus Minimum) für das gesamte Dataset dividiert. Anschließend werden die folgenden Schritte für jedes Eingabe-Feature durchgeführt:

- Ermitteln des benachbarten Features, das am nächsten gelegen ist. Mit dem Parameter Anzahl der Nachbarn wird festgelegt, wie viele Nachbarn verwendet werden sollen. Das Eingabe-Feature wird selbst als Nachbar gezählt.

- Führen Sie die Werte der beiden erneut skalierten Variablen aus den Nachbarn in ein Dataset zusammen.

- Erstellen des minimalen Spannbaums und Schätzen der Blockentropie.

- Randomisiertes Permutieren der Werte der beiden Variablen und Schätzen der Blockentropie für jede Permutation. Mit dem Parameter Anzahl der Permutationen wird festgelegt, wie viele Permutationen durchgeführt werden sollen.

- Berechnen eines Pseudo-p-Werts und Ermitteln, ob die Variablen eine statistisch signifikante Beziehung aufweisen.

Da bei dieser Vorgehensweise für jedes Eingabe-Feature ein anderer Hypothesentest durchgeführt wird, können Sie mit dem Parameter FDR-Korrektur anwenden (False Discovery Rate) den Anteil an falsch positiven Ergebnissen steuern (Fehler 1. Art).

Klassifizieren der lokalen Beziehungen

Es ist sehr wichtig, Bereiche zu identifizieren, in denen zwei Variablen eine statistisch signifikante Beziehung aufweisen. Für die Nutzung dieser Information ist es hilfreich, den Typ der Beziehung zwischen den Variablen anhand der Prognostizierbarkeit des Wertes der abhängigen Variablen durch die erklärende Variable zu bestimmen.

Jedes Feature lässt sich einer der folgenden Beziehungsarten zuordnen:

- Nicht signifikant: Die Beziehung zwischen den Variablen ist nicht statistisch signifikant.

- Positiv linear: Die abhängige Variable steigt in dem Maße linear an, wie die erklärende Variable ansteigt.

- Negativ linear: Die abhängige Variable sinkt in dem Maße linear, wie die erklärende Variable sinkt.

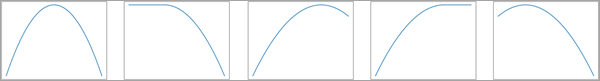

- Konkav: Die abhängige Variable ändert sich in dem Maße in eine konkave Kurve, wie die erklärende Variable zunimmt. Im Allgemeinen biegen oder wölben sich konkave Kurven nach unten.

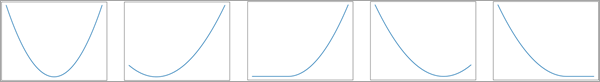

- Konvex: Die abhängige Variable ändert sich in dem Maße in eine konvexe Kurve, wie die erklärende Variable zunimmt. Im Allgemeinen biegen oder wölben sich konvexe Kurven nach oben.

- Undefiniert komplex: Die Variablen stehen in einer signifikanten Beziehung, aber die Art der Beziehung kann durch keine der Kategorien zuverlässig beschrieben werden.

Die folgenden Abbildungen zeigen Beispiele für eine konkave Beziehung:

Die folgenden Abbildungen zeigen Beispiele für eine konvexe Beziehung:

Klassifizieren Sie jedes signifikante Feature mit den folgenden Schritten:

- Schätzen eines gewöhnlichen linearen Regressionsmodells, um die abhängige Variable basierend auf der erklärenden Variablen vorherzusagen, und Berechnen des Informationskriteriums nach Akaike (AICc) für das Modell.

- Schätzen eines zweiten linearen Regressionsmodells, um die abhängige Variable basierend auf der erklärenden Variablen und dem Quadrat der erklärenden Variablen vorherzusagen (Quadrat-Regressionsmodell), und Berechnen des AICc.

- Vergleichen der AICc-Werte für die beiden Regressionsmodelle und Auswählen, welcher die Beziehung am besten repräsentiert. Der AICc des Quadrat-Regressionsmodells muss mindestens 3 Zeichen weniger umfassen als der AICc des linearen Regressionsmodells, damit das quadratische Modell ausgewählt wird. Andernfalls wird das lineare Modell gewählt.

- Berechnen Sie den angepassten R2-Wert für das gewählte Modell. Ist dieser kleiner als 0,05, erklärt das gewählte Modell weniger als 5 % der Datenvariation, und die Beziehung wird als Undefiniert komplex klassifiziert.

- Ist der angepasste R2-Wert größer als 0,05, findet die Klassifizierung anhand folgender Regeln statt:

- Wurde ein lineares Modell gewählt und ist der Koeffizient positiv, wird sie als Positiv linear klassifiziert.

- Wurde das lineare Modell gewählt und ist der Koeffizient negativ, so wird sie als Negativ linear klassifiziert.

- Wurde das quadratische Modell gewählt und ist der Koeffizient des quadratischen Terms positiv, wird sie als Konvex klassifiziert.

- Wurde das quadratische Modell gewählt und ist der Koeffizient des quadratischen Terms negativ, wird sie als Konkav klassifiziert.

Interpretieren der Ergebnisse

Die Ausgabe dieses Werkzeugs sind eine Feature-Class (symbolisiert durch den Beziehungstyp) sowie Summenstatistiken in Geoverarbeitungsmeldungen. Die Ausgabe-Features enthalten Informationsfelder sowie Pop-ups, in denen die Beziehung mit Scatterplots visualisiert wird.

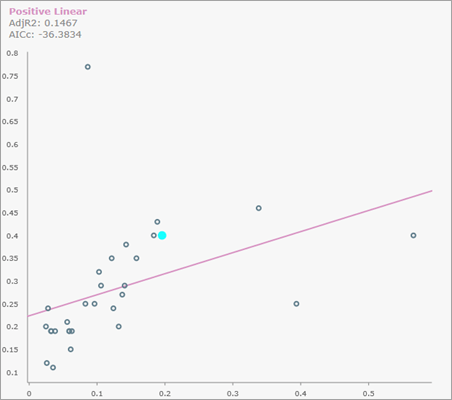

Scatterplot-Pop-ups

Falls angegeben, werden für jedes Ausgabe-Feature benutzerdefinierte Scatterplot-Pop-ups generiert, die durch Klicken auf die Features in der Karte angezeigt werden können. In der folgenden Abbildung wird ein Scatterplot-Pop-up für ein Feature mit einer positiven linearen Beziehung gezeigt:

Die erneut skalierte erklärende Variable wird auf der X-Achse und die erneut skalierte abhängige Variable auf der Y-Achse angezeigt. Der einzelne markierte Punkt im Scatterplot ist das Feature. Alle anderen Punkte sind Nachbarn des Features.

Zeigen Sie mit der Maus auf einen Punkt im Scatterplot, um die Quell-ID des Features anzuzeigen und die erneut skalierten Werte der abhängigen und erklärenden Variablen zusammen mit ihren unverarbeiteten Werten (ursprüngliche Skalierung) in Klammern einzublenden.

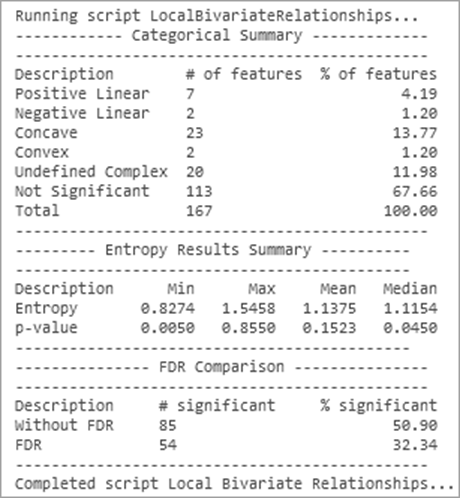

Geoverarbeitungsmeldungen

Zusammenfassende Informationen zur statistischen Signifikanz und den Typen der Beziehungen werden als Geoverarbeitungsmeldungen angezeigt. Nachfolgend finden Sie ein Beispiel für diese Meldungen.

Im Abschnitt Zusammenfassung der Kategorien der Meldung werden die Anzahl der Features und der jeweilige prozentuale Anteil für jeden Beziehungstyp aufgelistet. Im Abschnitt Zusammenfassung der Entropy-Ergebnisse werden das Minimum (Min), das Maximum (Max), der Durchschnitt (Mittelwert) und Medianwert der Entropie sowie die p-Werte der Eingabe-Features aufgelistet. Im Abschnitt FDR-Vergleich werden die Anzahl und der prozentuale Anteil der statistisch signifikanten Beziehungen mit und ohne Anwendung der FDR-Korrektur (False Discovery Rate) aufgelistet.

Hinweis:

Die Geoverarbeitungsmeldungen werden während der Ausführung des Werkzeugs am unteren Rand des Bereichs Geoverarbeitung angezeigt. Sie können auch über den Geoverarbeitungsverlauf auf diese Meldungen zugreifen, indem Sie mit der Maus auf die Fortschrittsleiste zeigen, auf die Pop-out-Schaltfläche  klicken oder den Abschnitt "Meldungen" im Bereich Geoverarbeitung einblenden.

klicken oder den Abschnitt "Meldungen" im Bereich Geoverarbeitung einblenden.

Ausgabefelder

Die Ausgabe des Werkzeugs enthält verschiedene Felder, die Informationen darüber bieten, wie und warum die einzelnen Features als der jeweilige Beziehungstyp kategorisiert wurden.

Signifikanz von Beziehungen

In den folgenden Feldern wird angegeben, ob die Beziehung zwischen der abhängigen und der erklärenden Variablen statistisch signifikant ist:

- Entropy: Der geschätzte Entropiewert für das Feature.

- P-values: Der Pseudo-p-Wert des Testes auf eine signifikante Beziehung zwischen der abhängigen und der erklärenden Variablen. Für diesen Wert findet keine FDR-Korrektur (False Discovery Rate) statt.

- Local Bivariate Relationship Confidence Level: Das höchste Konfidenzniveau, das für das Feature zutrifft. Die möglichen Werte für dieses Feld lauten Konfidenzniveau 90 %, Konfidenzniveau 95 %, Konfidenzniveau 99 % und Nicht signifikant. Wenn ein Wert für den Parameter FDR-Korrektur anwenden (False Discovery Rate) angegeben ist, wird das Konfidenzniveau entsprechend der False Discovery Rate angepasst.

Beziehungsklassifizierung

Die folgenden Felder enthalten Informationen über die Klassifizierung des Typs der Beziehung zwischen der abhängigen und der erklärenden Variablen:

- Type of Relationship: Der Typ der Beziehung zwischen der abhängigen und der erklärenden Variablen

- AICc (Linear): Das korrigierte Akaike Information Criterion für das lineare Modell

- R-squared (Linear): Der R2-Wert für das lineare Modell

- AICc (Polynomial): Das korrigierte Akaike Information Criterion für das Polynom-Modell

- R-squared (Polynomial): Der R2-Wert für das Polynom-Modell

Hinweis:

Der AICc-Wert und R2-Wert sind NULL für Features, die keine statistisch signifikante Beziehung zwischen der abhängigen und der erklärenden Variablen aufweisen.

Regressionskoeffizienten und Signifikanz

Die folgenden Felder bieten Informationen über die Koeffizienten des linearen Modells und Polynom-Modells, die zum Klassifizieren der Beziehung verwendet werden:

- Intercept: Der Schnittpunkt des linearen Modells.

- Coefficient (Linear): Der Koeffizient des linearen Terms des linearen Modells.

- Polynomial Intercept: Der Schnittpunkt des Polynom-Modells.

- Polynomial Coefficient (Linear): Der Koeffizient des linearen Terms des Polynom-Modells.

- Polynomial Intercept (Squared): Der Koeffizient des quadrierten Terms des Polynom-Modells.

- Significance of Coefficients (Linear): Ein Code aus zwei Zeichen, der angibt, ob der Schnittpunkt und Koeffizient mit einem Konfidenzniveau von 90 Prozent statistisch signifikant sind. Ein Unterstrich (_) gibt an, dass der Wert nicht statistisch signifikant ist, und ein Sternchen (*) gibt an, dass der Wert statistisch signifikant ist. Beispielsweise bedeutet "*_", dass der Schnittpunkt statistisch signifikant ist, der Koeffizient der linearen Regression jedoch nicht statistisch signifikant ist. Entsprechend bedeutet "_*", dass der Schnittpunkt nicht statistisch signifikant ist, der Koeffizient der linearen Regression jedoch statistisch signifikant ist.

- Significance of Coefficients (Polynomial): Ein Code aus drei Zeichen, der angibt, ob der Schnittpunkt, der Koeffizient der linearen Regression und der Koeffizient der quadratischen Regression des Polynom-Modells mit einem Konfidenzniveau von 90 Prozent statistisch signifikant sind. Beispielsweise bedeutet " *_*", dass der Schnittpunkt statistisch signifikant ist, der Koeffizient der linearen Regression nicht statistisch signifikant ist und der Koeffizient der quadratischen Regression statistisch signifikant ist.

Hinweis:

Alle Felder für Regressionskoeffizienten sind für jedes Feature, das keine statistisch signifikante Beziehung zwischen der abhängigen und der erklärenden Variablen aufweist, NULL oder leere Zeichenfolgen.

Tipps

Beachten Sie bei Verwendung des Werkzeugs Lokale bivariate Beziehungen die folgenden Tipps:

- Steuern Sie mit dem Parameter Skalierungsfaktor die Empfindlichkeit des Werkzeugs in Bezug auf schwächere Beziehungen. Bei Skalierungsfaktoren nahe 0 werden nur starke Beziehungen zwischen den Variablen erkannt, und Skalierungsfaktoren nahe 1 können zusätzlich schwächere Beziehungen erkennen. Der Standardwert von 0,5 ist ein Kompromiss, mit dem stärkere und moderate Beziehungen erkannt werden.

- Der für den Parameter Anzahl der Nachbarn gewählte Wert hat mehrere wichtige Auswirkungen. Wenn Sie eine größere Anzahl der Nachbarn verwenden, werden für jeden Hypothesentest mehr Daten bereitgestellt, wodurch die Wahrscheinlichkeit zunimmt, dass eine signifikante Beziehung ermittelt wird. Bei Verwendung vieler Nachbarn wird der Test weniger lokal, weil die Suche nach Nachbarn in einem größeren Umkreis erfolgen muss. Daher werden möglicherweise Beziehungen nicht erkannt, die sehr lokal sind. Zahlreiche Nachbarn verlängern zudem die Ausführungszeit des Werkzeugs erheblich.

- Bei Festlegung des Parameters Anzahl von Permutationen muss zwischen Genauigkeit und erhöhter Verarbeitungszeit abgewogen werden. Eine Erhöhung der Anzahl von Permutationen führt zu einer höheren Genauigkeit, da die Spanne möglicher Werte für den Pseudo-p-Wert zunimmt. Bei 99 Permutationen etwa liegt die Genauigkeit des Pseudo-p-Wertes bei 0,01 und bei 999 Permutationen bei 0,001. Diese Werte werden berechnet, indem 1 durch die Anzahl der Permutationen plus 1 geteilt wird: 1/(1+99) und 1/(1+999). Zu Beginn einer Problemanalyse kann eine niedrigere Anzahl von Permutationen verwendet werden. Es empfiehlt sich jedoch, die Anzahl der Permutationen für die Berechnung des Endergebnisses auf die höchstmögliche praktikable Zahl heraufzusetzen. Es empfiehlt sich zudem, eine große Anzahl der Permutationen zu verwenden, wenn zahlreiche Nachbarn verwendet werden.

Bibliografische Angaben

- Guo, D. "Local entropy map: a nonparametric approach to detecting spatially varying multivariate relationships." International Journal of Geographical Information Science 24, no. 9 (September 2010): 1367–1389.