很多 GIS 分析工作流的重要组成部分是比较研究区域中的两个变量,以确定两个变量间是否相关以及它们的关系如何。 例如,某些地区的糖尿病与肥胖之间是否存在关联? 从历史上看,此类问题往往是通过仔细的制图比较或线性回归分析来解决的。 但制图比较可能过于主观,回归分析也只能检测简单的关系。

局部二元关系工具可以通过确定其中一个变量的值是否取决于或受另一个变量的影响,并确定这些关系是否随地理空间而发生变化来量化同一地图上两个变量之间的关系。 该工具可计算每个局部邻域中的熵统计,从而量化两个变量间共享信息的数量。 与其他通常只能捕获线性关系的统计数据不同,熵可以捕获两个变量间的任何结构关系,包括指数、二次、正弦,甚至是无法使用典型数学函数表示的复杂关系。 此工具将接收面或点,并创建一个汇总了每个输入要素关系的重要性和形式的输出要素类。 此外,还提供自定义弹出窗口以及各种诊断、图表和消息。

可能的应用

可将此工具用于以下类型的应用:

- 美国疾病控制和预防中心 (CDC) 表示:“与体重正常或健康的人相比,肥胖者患重大疾病和出现健康问题的风险相对提高,这些疾病中就包括 2 型糖尿病。” CDC 可以使用此工具来量化肥胖和糖尿病之间关系的强度,并确定这一关系是否在整个研究区域都保持一致。

- 公共卫生官员可以探索空气污染水平与社会经济因素之间的关系,以发现潜在的环境不公正问题。

熵方法

两个变量彼此相关的意思是什么? 两个变量之间的关系可以有多种类型,但是从最简单的意义上讲,如果可以通过观察一个变量的值来了解另一个变量的信息,我们就说两个变量相关。 例如,通过观察有关肥胖的信息,可以获得有关糖尿病风险的信息。 两个变量间的这种关系称为相互依赖,反之,如果观察一个变量并不能获得关于另一个变量的信息,则这两个变量相互独立。

衡量变量间相关程度的一种方法是使用熵。 熵是信息理论的基本概念,它用于量化随机变量中的不确定性。 一般来说,变量的可预测性越低,熵就越高。 熵的用途很广泛,可以用于各随机变量,对于两个或两个以上变量之间的关系,还可以计算联合熵。 两个变量的联合熵等于第一个变量熵加上第二个变量的熵,减去两个变量的交互信息量。 交互信息可以有效量化变量之间的依赖程度,因为它可以直接测量通过观察一个变量的值可获得的另一个变量的相关信息量。

要估计交互信息,必须估计每个变量的熵及其联合熵。 但是,这些值取决于变量的基础分部,在实践中几乎无法得知。 幸运的是,最近的研究表明,多个变量的联合熵可以使用幂加权最小跨度树代替变量的联合分部进行估计 (Guo, 2010)。 这样就可以在不知道两个变量各自分布的情况下估计联合熵。 虽然能够估计联合熵很有用,但是我们需要知道变量间的交互信息以确定两个变量是否相关。 虽然您无法在不知道两个变量分布的情况下直接估计交互信息,但可以使用置换针对统计学上显著的关系构造零假设检验。

使用置换检验显著关系

如上一部分所示,两个变量是否相关的问题等同于询问它们的联合熵(可以估计)是否明显小于两个变量各自熵的总和(无法估计)。 换言之,即数据的估计联合熵是否明显小于两个变量相互独立时的联合熵?

为了确定这一问题,可通过随机地将第一变量的每个值重新分配给第二变量的新值来对变量执行置换检验。 通过随机配对,置换后的数据集将不会共享交互信息,但是两个变量各自的熵将不会发生变化。 通过生成多个置换数据集并估计每个数据集的联合熵,可以在两个变量相互独立且不相关的零假设下构建联合熵分布。 然后可以将根据实际数据估计的联合熵与该分布进行比较,并且可以根据联合熵小于实际数据联合熵的置换比例来计算伪 P 值。

检验局部空间关系

上述用于测试两个变量之间显著关系的步骤适用于任何连续的二元数据。 为了使其适应局部空间关系,可以使用邻域对每个输入要素执行此假设检验。 这样可以映射结果并识别局部区域中变量的显著关系。

因变量和解释变量参数的所有值均首先通过减去整个数据集的最小值并除以整个数据集的范围(最大值减去最小值)以重新调整为介于 0 到 1 之间的值。 然后,对每个输入要素执行以下步骤:

- 找到最近的相邻要素。 相邻要素数参数指定了将使用的相邻要素的数量。 输入要素本身也视作相邻要素。

- 将相邻要素中两个调整后的变量值合并为单个数据集。

- 构造最小跨度树并估计联合熵。

- 随机置换两个变量的值并估计每个置换检验的联合熵。 置换检验次数参数指定了将执行的置换数量。

- 计算伪 P 值并确定变量是否具有统计学上的显著关系。

由于此步骤对每个输入要素执行不同的假设检验,因此您可以使用应用错误发现率 (FDR) 校正参数来控制错误正值结果(1 型错误)的比例。

对局部关系进行分类

识别哪些区域中两个变量具有统计学上的显著关系非常重要。 要运用此信息,还需要根据解释变量预测因变量值的准确性来识别变量间关系的类型。

可以将要素分类为以下关系类型:

- 不显著 - 变量之间的关系不具有统计显著性。

- 正线性 - 随着解释变量的增加,因变量线性增加。

- 负线性 - 随着解释变量的增加,因变量线性减小。

- 凹 - 当解释变量增加时,因变量呈凹曲线变化。 一般来说,凹曲线向下弯曲或呈向下的圆弧状。

- 凸 - 当解释变量增加时,因变量呈凸曲线变化。 一般来说,凸曲线向上弯曲或呈向上的圆弧状。

- 未定义复杂项 - 变量显著相关,但关系类型无法可靠地界定为以上类别。

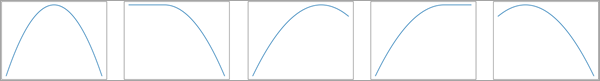

下图显示了一些凹函数关系的示例:

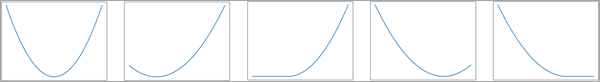

下图显示了一些凸函数关系的示例:

可以使用以下步骤对每个显著要素进行分类:

- 对普通线性回归模型进行估计以根据解释变量预测因变量并计算模型的修正 Akaike 信息准则 (AICc)。

- 对第二个线性回归模型进行估计以根据解释变量和解释变量的平方(二次回归模型)预测因变量,并计算 AICc。

- 比较两个回归模型的 AICc 值,并选择最能代表关系的模型。 为了选择二次模型,二次回归模型的 AICc 必须至少比线性回归模型的 AICc 小 3。 否则,将选择线性模型。

- 对于所选模型,将计算调整后的 R2 值。 如果值小于 0.05,则选择的模型将解释小于 5% 的数据变化,并将关系分类为未定义的复杂相关。

- 如果已调整的 R2 大于 0.05,则根据以下规则进行分类:

- 如果选择线性模型且系数为正,则分类为正线性。

- 如果选择线性模型且系数为负,则分类为负线性。

- 如果选择二次模型并且平方项的系数为正,则分类为凸函数。

- 如果选择二次模型并且平方项的系数为负,则分类为凹函数。

解释结果

此工具的输出是按照关系类型符号化的要素类以及地理处理消息中打印的汇总统计数据。 输出要素包含信息字段以及使用散点图可视化关系的弹出窗口。

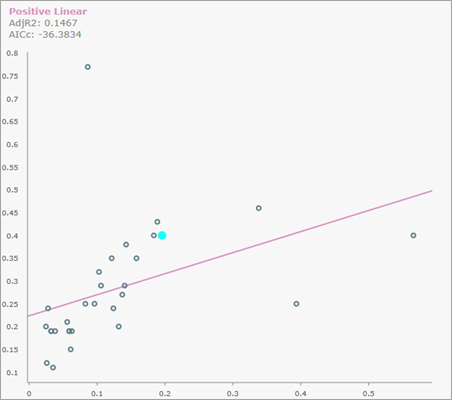

散点图弹出窗口

如果指定,则会为每个输出要素生成自定义散点图弹出窗口,并可通过单击地图中的要素来查看。 下图显示了具有正线性关系的要素的散点图弹出窗口:

调整后的解释变量显示在 x 轴上,调整后的因变量显示在 y 轴上。 散点图中单个突出显示的点为要素;所有其他点为要素的相邻要素。

可以将鼠标悬停在散点图中的某个点上,以查看要素的源 ID,并查看因变量和解释变量调整后的值以及括号中的原始(原始比例)值。

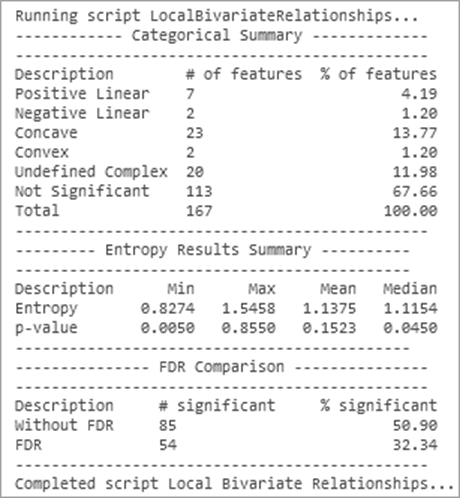

地理处理消息

有关统计显著性和关系类型的汇总信息显示为地理处理消息。 以下为这些消息的示例。

消息的分类汇总部分列出了每种关系类型的要素数量和百分比。 熵结果汇总部分列出了输入要素的熵的最小值 (Min)、最大值 (Max)、平均值 (Mean) 和中值 (Median) 以及 p 值。 FDR 比较部分列出了在应用和未应用错误发现率校正的情况下,统计学显著关系的数量和百分比。

注:

在工具执行期间,地理处理消息将显示在地理处理窗格底部。 可使用地理处理历史,通过将鼠标悬停在进度条上、单击弹出按钮  或展开地理处理窗格中的消息部分来访问消息。

或展开地理处理窗格中的消息部分来访问消息。

输出字段

工具输出包含多个字段,这些字段可提供有关将每个要素归类为其关系类型的方式和原因的信息。

关系显著性

以下字段可提供有关因变量和解释变量之间的关系是否具有统计显著性的信息:

- Entropy- 要素的估计熵值。

- P-values- 检验因变量和解释变量之间存在显著性关系的伪 p 值。 未针对错误发现率对该值进行调整。

- Local Bivariate Relationship Confidence Level- 该要素满足的最高置信度。 该字段的可能值为 90% 置信度、95% 置信度、99% 置信度和不具有显著性。 如果指定了应用错误发现率 (FDR) 校正参数值,则置信度将针对错误发现率进行调整。

关系分类

以下字段可提供有关对因变量和解释变量之间的关系类型进行分类的信息:

- Type of Relationship- 因变量和解释变量之间的关系类型

- AICc (Linear)- 线性模型的更正后的 Akaike 信息准则

- R-squared (Linear)- 线性模型的 R2 值

- AICc (Polynomial)- 多项式模型的更正后的 Akaike 信息准则

- R-squared (Polynomial)- 多项式模型的 R2 值

注:

对于因变量和解释变量之间不具有统计显著性的要素,AICc 和 R2 值将为空。

回归系数和显著性

以下字段可提供有关用于对关系进行分类的线性和多项式模型的系数的信息。

- Intercept- 线性模型的截距。

- Coefficient (Linear)- 线性模型的线性项的系数。

- Polynomial Intercept- 多项式模型的截距。

- Polynomial Coefficient (Linear)- 多项式模型的线性项的系数。

- Polynomial Intercept (Squared)- 多项式模型的平方项的系数。

- Significance of Coefficients (Linear)- 两个字符的代码,用于指示截距和系数在 90% 置信度情况下是否具有统计显著性。 下划线 (_) 指示该值不具有统计显著性,而星号 (*) 指示该值具有统计显著性。 例如,*_ 指示截距具有统计显著性,但线性系数不具有统计显著性。 类似地,_* 指示截距不具有统计显著性,但线性系数具有统计显著性。

- Significance of Coefficients (Polynomial)- 三个字符的代码,用于指示多项式模型的截距、线性系数和平方系数在 90% 置信度情况下是否具有统计显著性。 例如,*_* 指示截距具有统计显著性,线性系数不具有统计显著性,平方系数具有统计显著性。

注:

对于因变量和解释变量之间不具有统计显著性关系的每个要素,与回归系数相关的所有字段将为空或空字符串。

提示

使用时局部二元关系工具时,请考虑以下提示:

- 可以使用比例因子参数来控制工具对细微关系的灵敏度。 比例因子接近零时将仅检测变量间强关系,比例因子接近一时,将额外检测较弱的关系。 默认值 0.5 是一种折衷方案,可以检测强关系和中等关系。

- 您选择的相邻要素的数目参数值有几个重要的用意。 使用更多数量的相邻要素可为每个假设检验提供更多数据,从而增加了检测到显著关系的可能性。 但是,大量使用相邻要素会使检验的局部性降低,因为系统必须进一步搜索以查找相邻要素,所以可能无法检测到极具局部性的关系。 此外,大量的相邻要素也会使工具的执行时间急剧增加。

- 选择置换检验次数参数值时需要兼顾精度和所需增加的处理时间。 增加置换检验次数将凭借扩大伪 p 值的可能值范围而提高精度。 例如,当置换检验次数为 99 时,伪 p 值精度为 0.01,而置换检验次数为 999 时,精度则为 0.001。 计算这些值的方法是将 1 除以置换检验次数加 1 的和:1/(1+99) 和 1/(1+999)。 最初研究问题时可以使用较少的置换检验次数,但是要使最终结果的可行性达到最高,则增加置换检验次数不失为最佳实践。 此外,在使用大量相邻要素时,还建议使用更大的置换检验次数。

引用信息

- Guo, D. "Local entropy map: a nonparametric approach to detecting spatially varying multivariate relationships." International Journal of Geographical Information Science 24, no. 9 (September 2010): 1367-1389.