Mit der Image Analyst-Lizenz verfügbar.

Mit der Spatial Analyst-Lizenz verfügbar.

Alle überwachten Deep-Learning-Aufgaben hängen von beschrifteten Datasets ab, d. h., Menschen müssen ihr Wissen anwenden, um das neuronale Netzwerk für das Identifizieren oder Erkennen von relevanten Objekten zu trainieren. Das neuronale Netzwerk trainiert mithilfe der beschrifteten Objekte ein Modell, das zur Dateninferenzierung verwendet werden kann.

Die Beschriftung ist der Prozess, bei dem repräsentative Beispiele eines relevanten Objekts ausgewählt werden. Die für die Beschriftung ausgewählten Objekte müssen räumliche, spektrale, ausrichtungsbezogene, größenbezogene und zustandsbezogene Merkmale der relevanten Objekte genau darstellen. Je besser die beschrifteten Objekte das relevante Feature darstellen, umso besser wird das Deep-Learning-Modell trainiert, und umso genauer ist die Klassifizierung und Erkennung der Inferenzierung.

Die Annotation bzw. Beschriftung von Bildern ist für Deep-Learning-Aufgaben wie maschinelles Sehen und Lernen von entscheidender Bedeutung. Um ein gutes Deep-Learning-Modell zu trainieren, ist eine große Menge beschrifteter Daten erforderlich. Sofern geeignete Trainingsdaten zur Verfügung stehen, können Deep-Learning-Systeme bei der Feature-Extraktion, der Mustererkennung und der Lösung komplexer Probleme genaue Ergebnisse liefern. Sie können den Bereich Objekte für Deep Learning beschriften zum Beschriften von Daten verwenden.

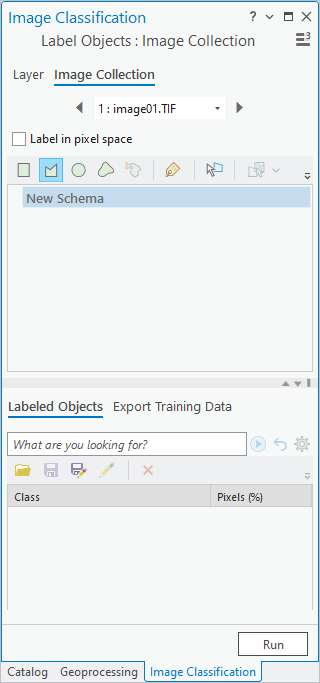

Sie finden die Schaltfläche Objekte für Deep Learning beschriften  im Dropdown-Menü Deep Learning Tools in der Gruppe Bildklassifizierung auf der Registerkarte Bilddaten. Wenn das Werkzeug geöffnet ist, wählen Sie aus, ob Sie einen vorhandenen Layer verwenden oder eine Bildsammlung erstellen möchten. Navigieren Sie für eine neue Bildsammlung zum Speicherort des Bilddatenordners. Dann wird ein Layer mit der Bildsammlung erstellt.

im Dropdown-Menü Deep Learning Tools in der Gruppe Bildklassifizierung auf der Registerkarte Bilddaten. Wenn das Werkzeug geöffnet ist, wählen Sie aus, ob Sie einen vorhandenen Layer verwenden oder eine Bildsammlung erstellen möchten. Navigieren Sie für eine neue Bildsammlung zum Speicherort des Bilddatenordners. Dann wird ein Layer mit der Bildsammlung erstellt.

Nachdem der Parameterwert Bilder/Bilddatensammlung angegeben wurde, wird der Bereich Objekte beschriften angezeigt. Der Bereich besteht aus zwei Teilen. Im oberen Teil des Bereichs werden die Klassen verwaltet, während der untere Teil des Bereichs verwendet wird, um die gesammelten Stichproben zu verwalten und die Trainingsdaten für Deep-Learning-Frameworks zu exportieren.

Erstellen von Klassen und Beschriften von Objekten

Im oberen Teil des Bereichs können Sie Objektklassen verwalten und Objekte zum Trainieren des Deep-Learning-Modells erstellen. Zum Erstellen beschrifteter Objekte stehen die folgenden Skizzenwerkzeuge und KI-gestützten Werkzeuge zur Verfügung:

| Werkzeug | Beschreibung |

|---|---|

| Ein beschriftetes Objekt durch Zeichnen eines Rechtecks um ein Feature oder Objekt im Bild erstellen. |

| Ein beschriftetes Objekt durch Zeichnen eines Polygons um ein Feature oder Objekt im Bild erstellen. |

| Ein beschriftetes Objekt durch Zeichnen eines Kreises um ein Feature oder Objekt im Bild erstellen. |

| Ein beschriftetes Objekt durch Zeichnen einer Freihandform um ein Feature oder Objekt im Bild erstellen. |

| Das Feature oder Objekt automatisch erkennen und beschriften. Um das Feature oder Objekt im Bild wird ein Polygon gezeichnet. Dieses Werkzeug ist nur verfügbar, wenn die Deep-Learning-Framework-Bibliotheken installiert sind. |

| Ein Feature durch Auswählen eines Segments aus einem segmentierten Layer erstellen. Diese Option ist nur verfügbar, wenn der Bereich Inhalt einen segmentierten Layer enthält. Aktivieren Sie die Segmentauswahl, indem Sie den segmentierten Layer im Bereich Inhalt auswählen, und wählen Sie den Layer dann in der Dropdown-Liste Segmentauswahl aus. |

| Weisen Sie dem aktuellen Bild die ausgewählte Klasse zu. Dieses Werkzeug ist nur im Modus "Bildsammlung" verfügbar. |

| Ein beschriftetes Objekt auswählen und bearbeiten |

| Ein Klassifizierungsschema erstellen |

| Wählen Sie eine Option für das Klassifizierungsschema aus.

|

| Die am Schema vorgenommenen Änderungen speichern |

| Eine Kopie des Schemas speichern |

| Dem Schema eine Klassenkategorie hinzufügen. Wählen Sie zunächst den Namen des Schemas aus, um eine übergeordnete Klasse auf höchster Ebene zu erstellen. Wählen Sie den Namen einer vorhandenen Klasse aus, um eine Unterklasse zu erstellen. |

| Die ausgewählte Klassen- oder Unterklassen-Kategorie aus dem Schema entfernen. |

KI-gestützte Beschriftungswerkzeuge

Es gibt zwei Arten von KI-Werkzeugen zum Beschriften von Objekten: Automatisch erkennen und Textvorgabe.

Werkzeug "Automatisch erkennen"

Mit dem Werkzeug Automatisch erkennen  wird automatisch ein Rechteck um ein Feature gezeichnet. Klicken Sie auf das Feature, damit ein umgebendes Rechteck darum herum gezeichnet wird. Wenn Sie eine Polygongrenze des Features benötigen, drücken Sie die Umschalt-Taste, und klicken Sie gleichzeitig auf das Feature. Daraufhin wird eine Umfanglinie um die Form des Features gezeichnet. Damit das Werkzeug erfolgreich eingesetzt werden kann, muss eine beträchtliche Anzahl der Pixel der Features auf der Karte angezeigt werden, sodass Sie die Features vergrößern müssen.

wird automatisch ein Rechteck um ein Feature gezeichnet. Klicken Sie auf das Feature, damit ein umgebendes Rechteck darum herum gezeichnet wird. Wenn Sie eine Polygongrenze des Features benötigen, drücken Sie die Umschalt-Taste, und klicken Sie gleichzeitig auf das Feature. Daraufhin wird eine Umfanglinie um die Form des Features gezeichnet. Damit das Werkzeug erfolgreich eingesetzt werden kann, muss eine beträchtliche Anzahl der Pixel der Features auf der Karte angezeigt werden, sodass Sie die Features vergrößern müssen.

Das Werkzeug Automatisch erkennen eignet sich gut, wenn verschiedene Features vorliegen, die sich durch verschiedene Formen, scharfe Kanten und hohen Kontrast auszeichnen. Es wird nicht empfohlen, wenn kontinuierliche Features in enger Nachbarschaft zueinander vorhanden sind.

Hinweis:

Die Deep-Learning-Frameworks für ArcGIS müssen für die Verwendung dieses Features installiert sein.

Im Folgenden finden Sie eine Liste der Tastenkombinationen für die Arbeit mit dem Werkzeug "Automatisch erkennen".

| Tastenkombination | Aktion | Beschreibung |

|---|---|---|

UMSCHALT + M | Den Mehrfachklick-Vorgang aktivieren | Aktivieren Sie den Vorgang, mit dem mehrere angrenzende Features zu einem einzelnen Feature zusammengefasst werden können. |

UMSCHALT+S | Den Mehrfachklick-Vorgang beenden | Deaktivieren Sie den Vorgang zum Zusammenführen angrenzender Features. |

UMSCHALT + Z | Undo | Vorgang für letztes angrenzendes Feature rückgängig machen Drücken Sie gleichzeitig die Tasten UMSCHALT + Z, und klicken Sie auf das letzte Feature. |

F | Feature fertig stellen | Das Feature wurde abgeschlossen. Halten Sie die F-Taste gedrückt, und klicken Sie auf das letzte Segment des hinzuzufügenden Features. |

A | Feature hinzufügen | Fügen Sie das erstellte Feature zum angrenzenden Feature hinzu. Halten Sie die A-Taste gedrückt, und klicken Sie auf das Feature, das Sie hinzufügen möchten. Dies ist nützlich, wenn der Mehrfachklick-Modus nicht aktiviert ist. |

L | Feature entfernen | Entfernen Sie das erstellte Feature zum angrenzenden Feature. Halten Sie die L-Taste gedrückt, und klicken Sie auf das Feature, das Sie entfernen möchten. |

UMSCHALT + A | Eine Konturlinie um ein Feature erstellen | Erstellen Sie ein Konturlinienpolygon um das zugrunde liegende Feature. Drücken Sie gleichzeitig die Tasten UMSCHALT + A, und klicken Sie auf das letzte Feature. Statt einem umgebenden Rechteck wird die Geometrie um das Feature herum erstellt. |

UMSCHALT + L | Eine Konturlinie um ein Feature entfernen | Entfernen Sie eine Konturlinie, die sich um ein Feature befindet. Halten Sie die Tasten UMSCHALT + L gedrückt, und klicken Sie auf das Konturlinien-Feature, um die Konturlinie zu entfernen. |

Werkzeug "Textvorgabe"

Mit dem Werkzeug Textvorgabe können Sie das Erkennungs-Feature als Unterstützung beim Beschriften verwenden. Geben Sie den Namen des Objekts in das Textfeld Klassenname ein, und klicken Sie auf die Schaltfläche Erkennen. Es wird empfohlen, für dieses Feature eine hochleistungsfähige GPU mit mindestens 12 GB RAM zu verwenden. Verwenden Sie die Tastenkombination Shift+O, um das Textvorgabe-Feature automatisch für eine Bildsammlung auszuführen.

Zur Verbesserung der Ergebnisse können Sie die Werte für Schwellenwert für Feld und Schwellenwert für Text in den Optionen für Konfigurieren festlegen.

- Schwellenwert für Feld: Dieser Wert wird für die Objekterkennung im Bild verwendet. Ein höherer Wert macht das Modell selektiver, und es werden nur die Objektinstanzen mit der höchsten Konfidenz identifiziert, was insgesamt zu weniger Erkennungen führt. Durch einen niedrigeren Wert wird das Modell toleranter, was zu mehr Erkennungen führt, zu denen auch solche mit geringerer Konfidenz gehören. Die Schwellenwerte liegen zwischen 0 und 1.

- Schwellenwert für Text: Dieser Wert wird zum Verknüpfen der erkannten Objekte mit der bereitgestellten Textvorgabe verwendet. Ein höherer Wert erfordert eine stärkere Verknüpfung zwischen dem Objekt und der Textvorgabe und führt zu präziseren, aber potenziell weniger Verknüpfungen. Ein niedrigerer Wert ermöglicht schwächere Verknüpfungen, durch die die Anzahl der Verknüpfungen steigen kann, wobei sich jedoch auch weniger präzise Übereinstimmungen ergeben. Die Schwellenwerte liegen zwischen 0 und 1.

- Anomalien entfernen: Diese Option entfernt alle Features, die sich im Hinblick auf die Verteilung der Shape-Fläche nicht innerhalb des Median-Bereichs befinden. Die Standardeinstellung ist "False".

Hinweis:

Die Deep-Learning-Frameworks für ArcGIS müssen für die Verwendung dieses Features installiert sein.

Dialogfeld "Klasse definieren"

Im Dialogfeld Klasse definieren können Sie eine Klasse erstellen oder eine vorhandene Klasse definieren. Mit der Option Vorhandene Klasse verwenden können Sie die entsprechende Option Klassenname für das Objekt auswählen. Mit der Option Neue Klasse hinzufügen können Sie die Informationen bearbeiten, bevor Sie auf OK klicken, um die Klasse zu erstellen.

Registerkarte "Beschriftete Objekte"

Die Registerkarte Beschriftete Objekte befindet sich im unteren Abschnitt des Bereichs Objekte beschriften. Hier verwalten Sie die Trainingsgebiete, die Sie für die einzelnen Klassen gesammelt haben. Sammeln Sie für jede Klasse im Bild repräsentative Standorte oder Trainingsgebiete. Ein Trainingsgebiet verfügt über Positionsinformationen (Polygon) und eine zugehörige Klasse. Der Bildklassifizierungsalgorithmus verwendet die als Feature-Class gespeicherten Trainingsgebiete, um die Landbedeckungsklasse im gesamten Bild zu identifizieren.

Sie können Trainingsgebiete anzeigen und verwalten, indem Sie diese hinzufügen, gruppieren oder entfernen. Wenn Sie auf ein Trainingsgebiet klicken, wird es auf der Karte markiert. Doppelklicken Sie auf ein Trainingsgebiet in der Tabelle, um auf der Karte darauf zu zoomen.

Die Werkzeuge auf der Registerkarte Beschriftete Objekte werden in der folgenden Tabelle beschrieben:

| Werkzeug | Beschreibung |

|---|---|

| Eine vorhandene Trainingsgebiet-Feature-Class öffnen |

| Die an der aktuellen Feature-Class mit beschrifteten Objekten vorgenommenen Änderungen speichern |

| Die aktuellen beschrifteten Objekte als eine neue Feature-Class speichern |

| Die ausgewählten beschrifteten Objekte löschen |

Registerkarte "Trainingsdaten exportieren"

Nachdem die Stichproben gesammelt wurden, können Sie sie durch Klicken auf die Registerkarte Trainingsdaten exportieren als Trainingsdaten exportieren. Anschließend können die Trainingsdaten in einem Deep-Learning-Modell verwendet werden. Nachdem Sie die unten beschriebenen Parameterwerte festgelegt haben, klicken Sie auf Ausführen, um die Trainingsdaten zu erstellen.

| Parameter | Beschreibung |

|---|---|

Ausgabeordner | Der Ausgabeordner, in dem die Trainingsdaten gespeichert werden sollen |

Polygon-Features maskieren | Eine Polygon-Feature-Class zur Abgrenzung der Fläche, in der Bildausschnitte erstellt werden. Es werden nur Bildausschnitte erstellt, die vollständig in die Polygone fallen. |

Bildformat | Gibt das Raster-Format für die ausgegebenen Bildausschnitte an.

Die Formate PNG und JPEG unterstützen bis zu drei Bänder. |

Kachelgröße X | Größe der Bildausschnitte (X-Dimension). |

Kachelgröße Y | Größe der Bildausschnitte (Y-Dimension). |

Schritt X | Verschiebung in X-Richtung bei Erstellung der nächsten Bildausschnitte. Wenn der Schritt der Kachelgröße entspricht, gibt es keine Überlappung. Wenn der Schritt der halben Kachelgröße entspricht, gibt es eine Überlappung von 50 Prozent |

Schritt Y | Verschiebung in Y-Richtung bei Erstellung der nächsten Bildausschnitte. Wenn der Schritt der Kachelgröße entspricht, gibt es keine Überlappung. Wenn der Schritt der halben Kachelgröße entspricht, gibt es eine Überlappung von 50 Prozent |

Drehwinkel | Der Drehwinkel, der für die Generierung von Bildausschnitten verwendet wird. Zunächst wird ein Bildausschnitte ohne Drehung generiert. Danach wird um den angegebenen Winkel gedreht, um weitere Bildausschnitte zu erstellen. Bei jeder Drehung wird ein Bildausschnitt erstellt, bis das Bild vollständig gedreht wurde. Wenn Sie beispielsweise einen Drehwinkel von 45 Grad angeben, werden acht Bildausschnitte erstellt. Die acht Bildausschnitte werden bei folgenden Winkeln erstellt: 0, 45, 90, 135, 180, 255, 270 und 315. |

NoFeature-Kacheln ausgeben | Gibt an, ob Bildausschnitte, die keine Trainingsgebiete erfassen, exportiert werden.

Das Sammeln von Bildausschnitten, die keine Trainingsgebiete enthalten, kann dem Modell helfen, Objekte zu identifizieren, die nicht zu den Ergebnissen gehören sollten, z. B. falsch positive Objekte. Dadurch kann auch eine Überanpassung reduziert werden. |

Metadatenformat | Gibt das Format für die ausgegebenen Metadaten-Label an. Wenn es sich bei den Eingabedaten für das Trainingsgebiet um einen Feature-Class-Layer handelt, wie zum Beispiel eine Gebäude-Layer- oder Standardklassifizierungs-Trainingsgebiet-Datei, verwenden Sie die Option KITTI-Beschriftungen oder PASCAL Visual Object Classes (KITTI_rectangles oder PASCAL_VOC_rectangles in Python). Die Ausgabe-Metadaten sind eine .txt-Datei oder eine .xml-Datei mit den Daten für das Trainingsgebiet, die im kleinsten umgebenden Rechteck enthalten sind. Der Name der Metadatendatei stimmt mit dem Namen des Eingabequellbildes überein. Wenn es sich bei den Eingabedaten für das Trainingsgebiet um eine Class-Karte handelt, verwenden Sie als Format für die Ausgabe-Metadaten die Option Klassifizierte Kacheln (Classified_Tiles in Python).

Beim KITTI-Metadatenformat werden 15 Spalten erstellt, jedoch nur 5 davon im Werkzeug verwendet. Die erste Spalte ist der Klassenwert. Die nächsten 3 Spalten werden übersprungen. In den Spalten 5 bis 8 wird das kleinste umgebende Rechteck definiert, das aus vier Bildkoordinatenpositionen besteht. Diese sind die Pixel links, oben, rechts und unten. Das kleinste umgebende Rechteck umfasst den im Deep-Learning-Klassifikator verwendeten Trainingsbildausschnitt. Die verbleibenden Spalten werden nicht verwendet. |

Feature schwärzen | Gibt an, ob die Pixel um die einzelnen Objekte oder Features in den Bildkacheln maskiert werden sollen.

Dieser Parameter findet nur Anwendung, wenn der Parameter Metadatenformat auf Beschriftete Kacheln festgelegt ist und eine Eingabe-Feature-Class oder ein klassifiziertes Eingabe-Raster angegeben wurde. |

Zuschneide-Modus | Gibt an, ob die exportierten Kacheln auf die gleiche Größe zugeschnitten werden sollen.

Dieser Parameter findet nur Anwendung, wenn der Parameter Metadatenformat auf Beschriftete Kacheln oder ImageNet festgelegt ist und eine Eingabe-Feature-Class oder ein klassifiziertes Eingabe-Raster angegeben wurde. |

Bezugssystem | Gibt den Typ von Bezugssystem an, mit dem das Eingabebild interpretiert wird. Das angegebene Bezugssystem muss mit dem Bezugssystem übereinstimmen, das für das Training des Deep-Learning-Modells verwendet wurde.

|

Zusätzliches Eingabe-Raster | Eine zusätzliche Eingabequelle aus Bilddaten für Bild-zu-Bild-Übersetzungsmethoden. Dieser Parameter ist gültig, wenn der Parameter Metadatenformat auf Klassifizierte Kacheln, Kacheln exportieren oder CycleGAN festgelegt wurde. |

Die exportierten Trainingsdaten können jetzt in einem Deep-Learning-Modell verwendet werden.